Meta发布了五个重要的新AI模型和研究,包括可以处理文本和图像的多模态系统、下一代语言模型、音乐生成、AI语音检测以及改善AI系统多样性的努力。

这些发布来自Meta的基础AI研究(FAIR)团队,该团队已经致力于通过开放研究和合作推动AI发展超过十年。随着AI的快速创新,Meta认为与全球社区合作至关重要。

Meta表示:“通过公开分享这些研究,我们希望激发创新,并最终帮助以负责任的方式推进AI。”

其中发布的内容包括Meta的“Chameleon”模型的关键组件,该模型是一个多模态模型系列,可以同时理解和生成文本和图像,而大多数大型语言模型通常是单模态的。

Meta解释道:“就像人类可以同时处理文字和图像一样,Chameleon可以同时处理和输出图像和文本。Chameleon可以接受任何文本和图像的组合作为输入,并输出任何文本和图像的组合。”

潜在的用途几乎是无限的,从生成创意标题到通过文本和图像提示新场景。

此外,Meta还发布了使用“多令牌预测”进行代码补全的预训练模型,该模型使用非商业研究许可证。传统的语言模型训练通过预测下一个单词来进行,效率低下。而多令牌模型可以同时预测多个未来单词,以加快训练速度。

Meta表示:“虽然(预测一个单词的)方法简单且可扩展,但效率低下。它需要比儿童学习相同程度的语言流利度所需的文本多几个数量级。”

在创意方面,Meta的JASCO允许从文本生成音乐片段,并通过接受和处理和弦和节拍等输入来提供更多控制。

Meta解释道:“虽然现有的文本到音乐模型(如MusicGen)主要依赖文本输入进行音乐生成,但我们的新模型JASCO能够接受各种输入,如和弦或节拍,以提高对生成音乐输出的控制。”

Meta声称AudioSeal是第一个用于检测AI生成语音的音频水印系统。它可以在较大的音频片段中快速定位由AI生成的特定片段,速度比以前的方法快485倍。

Meta表示:“AudioSeal将以商业许可证发布。这只是我们分享的几个负责任研究领域之一,旨在帮助防止生成AI工具的滥用。”

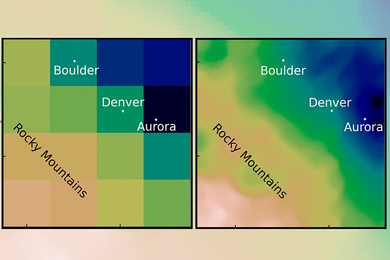

另一个重要的发布旨在改善文本到图像模型的多样性,因为这些模型通常会显示地理和文化偏见。

Meta开发了自动指标来评估潜在的地理差异,并进行了一个超过65,000个注释的大型研究,以了解全球人们对地理代表的看法。

Meta表示:“这将使AI生成的图像更具多样性和更好的代表性。”相关的代码和注释已经发布,以帮助改善生成模型的多样性。

通过公开分享这些开创性的模型,Meta希望促进合作并推动AI社区的创新。

(照片由Dima Solomin提供)

想要从行业领导者那里了解更多关于AI和大数据的知识吗?请查看在阿姆斯特丹、加利福尼亚和伦敦举办的AI&Big Data Expo。这个综合性的活动与其他领先的活动同时举办,包括智能自动化会议、BlockX、数字转型周和网络安全与云计算博览会。

探索由TechForge提供支持的其他即将举行的企业技术活动和网络研讨会。