无论你是在描述故障汽车发动机的声音,还是像邻居的猫一样喵喵叫,用声音模仿声音可以是传达概念的一种有用方式,当语言无法表达时。

声音模仿是用声音传达信息的快速图画的声学等价物——只不过你不是用铅笔来描绘图像,而是用你的声道来表达声音。这可能看起来很困难,但这是我们所有人直观地做的事情:为了亲身体验,试着用你的声音模仿救护车的警报声、乌鸦的叫声或钟声。

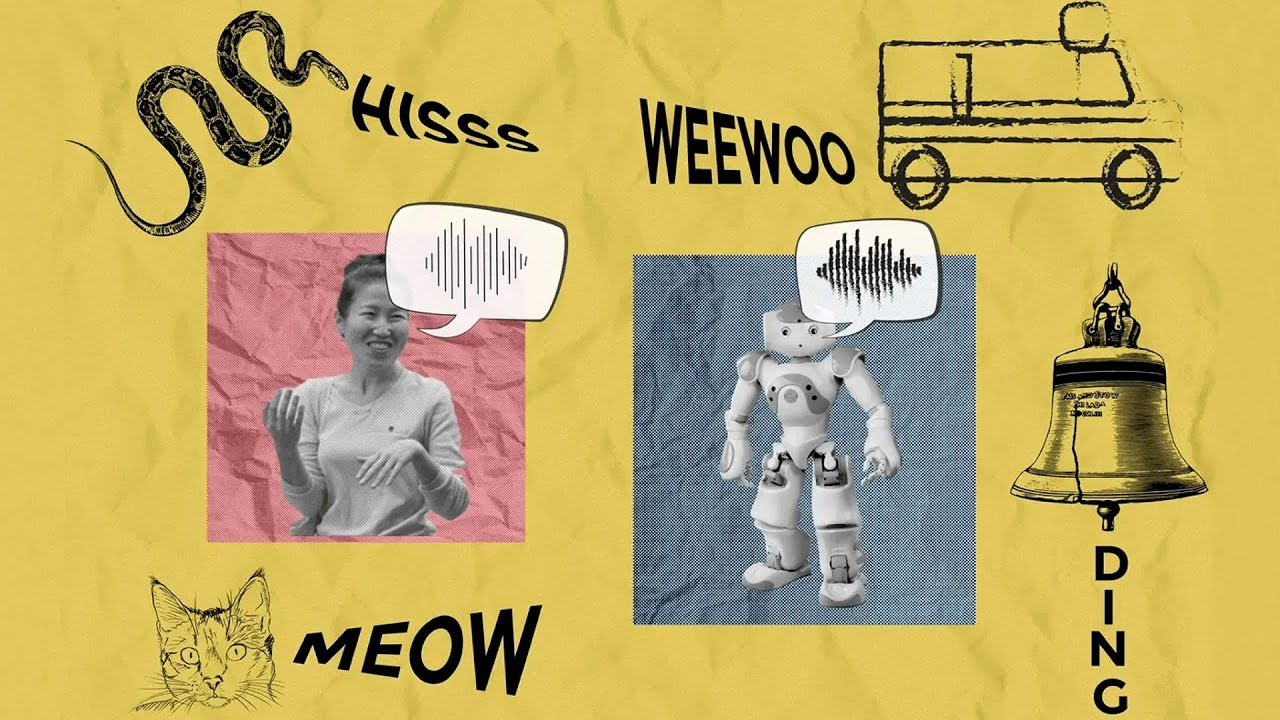

受到我们如何交流的认知科学启发,麻省理工学院计算机科学与人工智能实验室(CSAIL)的研究人员开发了一种AI系统,可以在没有训练的情况下产生类似人类的声音模仿,且从未“听过”人类的声音印象。

为了实现这一点,研究人员设计了他们的系统,使其产生和解释声音的方式与我们相似。他们首先构建了一个人类声道的模型,模拟声音箱的振动如何被喉咙、舌头和嘴唇塑造。然后,他们使用一种受认知启发的AI算法来控制这个声道模型,使其产生模仿,考虑到人类选择交流声音的特定上下文方式。

该模型可以有效地从世界上获取许多声音,并生成类似人类的模仿——包括树叶沙沙声、蛇的嘶嘶声和接近的救护车警报声。他们的模型也可以反向运行,从人类的声音模仿中猜测现实世界的声音,类似于一些计算机视觉系统可以根据草图检索高质量图像。例如,该模型可以正确区分人类模仿猫的“喵”声与“嘶嘶”声的声音。

未来,这个模型可能会导致更直观的“基于模仿”的声音设计界面,更像人类的AI角色在虚拟现实中,甚至帮助学生学习新语言的方法。

共同首席作者——麻省理工学院CSAIL博士生Kartik Chandra SM ’23和Karima Ma,以及本科研究员Matthew Caren——指出,计算机图形学研究人员早已认识到,现实主义很少是视觉表达的最终目标。例如,抽象画或孩子的蜡笔涂鸦可以和照片一样富有表现力。

“在过去的几十年里,草图算法的进步为艺术家提供了新工具,AI和计算机视觉的进步,甚至对人类认知的更深理解,”Chandra指出。“就像草图是图像的抽象、非照片现实主义表现一样,我们的方法捕捉了人类表达他们听到的声音的抽象、非声学现实主义方式。这教会了我们关于听觉抽象的过程。”

模仿的艺术,分为三部分

团队开发了三个越来越细致的模型版本,以与人类声音模仿进行比较。首先,他们创建了一个基线模型,旨在生成尽可能与现实世界声音相似的模仿——但这个模型与人类行为的匹配并不好。

研究人员随后设计了第二个“交流”模型。根据Caren的说法,这个模型考虑了声音对听众的独特性。例如,你可能会通过模仿摩托艇发动机的轰鸣声来模仿摩托艇的声音,因为那是它最独特的听觉特征,即使它不是声音中最响亮的部分(与水花声相比)。这个第二个模型生成的模仿比基线模型更好,但团队希望进一步改进它。

为了将他们的方法更进一步,研究人员在模型中添加了最后一层推理。“声音模仿的效果可能会根据你投入的努力程度而有所不同。产生完全准确的声音需要时间和精力,”Chandra说。研究人员的完整模型考虑到了这一点,试图避免非常快速、响亮或高低音调的发声,这些在对话中人们不太可能使用。结果是:更像人类的模仿,紧密匹配人类在模仿相同声音时所做的许多决策。

在构建这个模型后,团队进行了一个行为实验,以查看AI生成的声音模仿或人类生成的声音模仿是否被人类评审认为更好。值得注意的是,实验中的参与者在一般情况下偏爱AI模型25%的时间,对于摩托艇的模仿高达75%,对于枪声的模仿为50%。

朝着更具表现力的声音技术

对音乐和艺术技术充满热情的Caren设想,这个模型可以帮助艺术家更好地将声音传达给计算系统,并帮助电影制片人和其他内容创作者生成更符合特定上下文的AI声音。它还可以使音乐家通过模仿难以用文本提示描述的噪音,快速搜索声音数据库。

与此同时,Caren、Chandra和Ma正在研究他们的模型在其他领域的影响,包括语言的发展、婴儿如何学习说话,甚至模仿行为在鹦鹉和鸣禽等鸟类中的表现。

团队在当前版本的模型上仍有工作要做:它在某些辅音(如“z”)上表现不佳,导致对某些声音(如蜜蜂嗡嗡声)的不准确印象。他们也尚未能够复制人类模仿语言、音乐或在不同语言中以不同方式模仿的声音(如心跳)的方式。

斯坦福大学语言学教授Robert Hawkins表示,语言中充满了拟声词和模仿但并不完全复制其描述事物的词汇,例如“喵”声非常不准确地近似猫发出的声音。“将我们从真实猫的声音转变为‘喵’这样的词的过程揭示了生理、社会推理和交流在语言演变中的复杂相互作用,”Hawkins说,他并未参与CSAIL的研究。“这个模型为形式化和测试这些过程的理论提供了一个令人兴奋的步骤,表明人类声道的物理限制和交流的社会压力都是解释声音模仿分布所必需的。”

Caren、Chandra和Ma与另外两位CSAIL成员共同撰写了论文:麻省理工学院电气工程与计算机科学系副教授Jonathan Ragan-Kelley和麻省理工学院脑与认知科学教授、脑、心智与机器中心成员Joshua Tenenbaum。他们的工作部分得到了赫兹基金会和国家科学基金会的支持。该研究于12月初在SIGGRAPH Asia上展示。