组织越来越多地利用机器学习模型来分配稀缺资源或机会。例如,这些模型可以帮助公司筛选简历,以选择面试候选人,或帮助医院根据患者的生存可能性对肾脏移植患者进行排名。

在部署模型时,用户通常努力确保其预测是公平的,通过减少偏见。这通常涉及调整模型用于决策的特征或校准其生成的分数等技术。

然而,麻省理工学院和东北大学的研究人员认为,这些公平性方法不足以解决结构性不公正和固有的不确定性。在一篇新论文中,他们展示了以结构化方式随机化模型的决策如何在某些情况下改善公平性。

例如,如果多家公司使用相同的机器学习模型以确定性方式对面试候选人进行排名——没有任何随机化——那么一个值得的人可能会在每个职位中都被排在最后,可能是由于模型对在线表单中提供的答案的权重分配。将随机化引入模型的决策中,可以防止一个有价值的人或群体总是被拒绝稀缺资源,比如面试机会。

通过他们的分析,研究人员发现,当模型的决策涉及不确定性或同一群体持续收到负面决策时,随机化尤其有益。

他们提出了一个框架,可以通过加权抽签的方式在模型的决策中引入特定数量的随机化。这个方法可以根据个人的情况进行调整,可以在不损害模型的效率或准确性的情况下改善公平性。

“即使你能够做出公平的预测,你是否应该仅仅根据分数或排名来决定这些稀缺资源或机会的社会分配?随着事情的扩大,我们看到越来越多的机会由这些算法决定,这些分数中固有的不确定性可能会被放大。我们表明,公平性可能需要某种形式的随机化,”来自数据、系统与社会研究所(IDSS)的研究生、论文的主要作者Shomik Jain说。

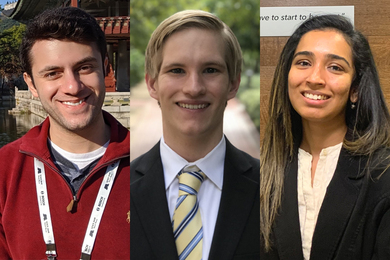

Jain的论文合作者包括东北大学哲学与计算机科学助理教授Kathleen Creel;以及资深作者Ashia Wilson,她是电气工程与计算机科学系的Lister Brothers职业发展教授,也是信息与决策系统实验室(LIDS)的首席研究员。该研究将在国际机器学习会议上进行展示。

考虑主张

这项工作建立在一篇先前的论文之上,研究人员探讨了在大规模使用确定性系统时可能发生的危害。他们发现,使用机器学习模型以确定性方式分配资源可能会放大训练数据中存在的不平等,从而加剧偏见和系统性不平等。

“随机化是统计学中一个非常有用的概念,令我们高兴的是,它满足了来自系统和个体两个角度的公平性要求,”Wilson说。

在这篇论文中,他们探讨了随机化何时可以改善公平性的问题。他们围绕哲学家John Broome的思想进行了分析,Broome曾写到使用抽签以尊重所有个体主张的方式来分配稀缺资源的价值。

一个人对稀缺资源(如肾脏移植)的主张可以源于优点、应得性或需求。例如,每个人都有生存的权利,他们对肾脏移植的主张可能源于这一权利,Wilson解释道。

“当你承认人们对这些稀缺资源有不同的主张时,公平性将要求我们尊重所有个体的主张。如果我们总是将资源给予主张更强的人,这公平吗?”Jain说。

这种确定性分配可能导致系统性排斥或加剧模式不平等,即当获得一次分配会增加个体获得未来分配的可能性。此外,机器学习模型可能会出错,而确定性方法可能会导致同样的错误被重复。

随机化可以克服这些问题,但这并不意味着模型做出的所有决策都应该同等随机化。

结构化随机化

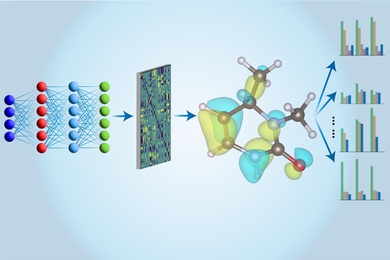

研究人员使用加权抽签来根据模型决策中涉及的不确定性程度调整随机化的水平。一个不太确定的决策应该包含更多的随机化。

“在肾脏分配中,通常规划是围绕预期寿命进行的,而这非常不确定。如果两个患者的年龄相差只有五年,测量就变得更加困难。我们希望利用这种不确定性来量身定制随机化,”Wilson说。

研究人员使用统计不确定性量化方法来确定在不同情况下需要多少随机化。他们表明,经过校准的随机化可以为个体带来更公平的结果,而不会显著影响模型的效用或有效性。

“在整体效用和尊重接受稀缺资源的个体权利之间需要取得平衡,但通常这种权衡相对较小,”Wilson说。

然而,研究人员强调,在某些情况下,随机化决策不会改善公平性,甚至可能对个体造成伤害,例如在刑事司法背景下。

但在其他领域,随机化可能会改善公平性,例如大学招生,研究人员计划在未来的工作中研究其他用例。他们还希望探讨随机化如何影响其他因素,如竞争或价格,以及如何用于提高机器学习模型的鲁棒性。

“我们希望我们的论文是朝着说明随机化可能带来好处的第一步。我们将随机化作为一种工具。你希望实施多少将由所有分配中的利益相关者决定。当然,他们如何决定又是另一个研究问题,”Wilson说。